Denken statt Prompten lernen: Ein Plädoyer für menschliche Souveränität im KI-Zeitalter

Warum KI-Kompetenz nicht bedeutet, möglichst effizient mit Technologie umzugehen, sondern zutiefst menschliche Fähigkeiten zu schulen: kritisches Denken, Empathie und ethisches Urteilsvermögen.

Technologie überholt unsere Moral: Ein gefährliches Ungleichgewicht

Normalerweise schreibe ich nicht viel, doch ein Gedanke lässt mich seit Tagen nicht los.

Ich würde mich selbst als technologieoffen beschreiben: ich probiere aus, bin neugierig, lerne – und natürlich nutze ich KI-Tools in meiner täglichen Arbeit. Doch gleichzeitig wächst in mir der Eindruck, dass die technologische Entwicklung schneller voranschreitet, als wir lernen, verantwortungsvoll damit umzugehen.

Insbesondere im Angesicht des postfaktischen Zeitalters des Populismus und der Aufmerksamkeitsökonomie, in dem wir uns gerade befinden, wirft das bei mir immer drängendere Fragen auf.

Der gedankliche Anstoß für diesen Artikel war ein Gespräch auf einer Marketing-Konferenz. Natürlich ging es auch dort um den Einsatz von KI insbesondere im Online-Marketing. Ich selbst habe meinen beruflichen Hintergrund im digitalen Marketing. Und ja, es war immer unser Job in der digitalen Welt Sichtbarkeit zu erzeugen, Kaufentscheidungen zu beeinflussen oder mit cleveren Ideen einen Wettbewerbsvorteil zu schaffen, um aus dem Lärm der Masse hervorzustechen. Inzwischen blicke ich kritischer auf meinen Job und ebendiese Welt. Ich sehe, wie unbedacht und manchmal verantwortungslos mit Technologie umgegangen wird – im Herzen einer Branche, die Technologie professionell und mit viel Begeisterung nutzt.

Zurück zum Stein des Anstoßes: Ich habe also am Rande der Vorträge dieses Gespräch über Auswirkungen von KI-Technologien und deren Einsatz geführt. Wir fragten uns „Haben wir Angst vor dem, was da auf uns zurollt?“ Eine Antwort darauf ist mir hängen geblieben: „Wir dachten vor 20 Jahren auch, dass das Internet und insbesondere die sozialen Medien unsere Gesellschaften demokratisieren werden. Dass wir dabei in weiten Teilen versagt haben, zeigt mir, dass wir alles andere als bereit sind für die Auswirkungen, die KI auf unsere Gesellschaft und uns als Menschen haben wird.“

Sind wir heute bereit für KI? Zweifellos bringt technologischer Fortschritt auch immer Positives hervor. Wir haben Zugang zu Information, Bildung und Teilhabe wie nie zuvor. Wir können uns vernetzen und müssen keine Machtposition innehaben, um Bewegungen anzustoßen. Gleichzeitig hat diese Technologie das Widerlichste in uns Menschen herausgekehrt. Noch nie war es leichter Fake News zu verbreiten. Noch nie war es bequemer die eigene Unsicherheit mit Aufmerksamkeit zu kompensieren. Noch nie war es einfacher sich in der eigenen Echokammer zu verirren. Noch nie war es gemütlicher im Schutz der Anonymität zu Straftaten aufzurufen oder selbst zu begehen.

All das ist unter anderem ein Ergebnis algorithmischer Geschäftsmodelle, die das Gemeinwohl dem Streben nach Aufmerksamkeit unterordnen. Vielleicht haben wir zu sehr darauf vertraut, dass Technologie uns all das Positive ermöglicht – und dabei vergessen, dass Technologie keine eigene Intention oder Motivation hat uns den Weg dafür zu bereiten.

Ich konnte bestürzt feststellen, wie schnell und wie intensiv Personen eine emotionale Beziehung zum Computer herstellten und wie sie ihm eindeutig menschliche Eigenschaften zuschrieben.

Joseph Weizenbaum

Wiederholen wir die Fehler der Vergangenheit?

Bemerkenswert finde ich bei der momentanen Entwicklung unserer Technologiegläubigkeit wie alt die Warnungen davor eigentlich sind. Bereits vor über einem halben Jahrhundert, Mitte der 60er Jahre, stellte Joseph Weizenbaum, Informatikpionier und Erfinder von ELIZA, folgendes fest:

„Ich konnte bestürzt feststellen, wie schnell und wie intensiv Personen eine emotionale Beziehung zum Computer herstellten und wie sie ihm eindeutig menschliche Eigenschaften zuschrieben.“ (Weizenbaum, Die Macht der Computer)

ELIZA gilt als der erste Chatbot in der Geschichte der Informatik. Mit Hilfe eines Skripts ermöglichte es eine Gesprächsinteraktion zwischen Menschen und Computer. Versuchspersonen ließen sich nicht nur auf ernsthafte Gespräche mit ELIZA ein, sondern vertrauten dem Computer persönliche Dinge an und schrieben ihm menschliche Fähigkeiten wie Einfühlungsvermögen zu. Es war vielen nicht wichtig, dass sie mit einer Maschine sprachen. Es reichte, dass es menschlich wirkte. Der sogenannte „ELIZA-Effekt” machte Weizenbaums Chatbot zu einem Meilenstein der KI-Forschung.

Bemerkenswert finde ich in diesem Zusammenhang, dass Menschen einem im nach heutigen Maßstäben primitivem System diese Eigenschaften zuschreiben. Wir sind also bereit Systemen zu glauben, noch bevor sie wirklich „intelligent“ wirken. Wenn bereits vor über 60 Jahren klar war, dass wir Menschlichkeit in technische Systeme hineinprojizieren, dann wiederholen wir gerade dieselben Fehler – nur eben globaler, schneller und vielleicht radikaler.

Wenn Beziehungen zur Simulation werden: Die Werteverschiebung

Wie blind wir dafür sind, macht mir ein Artikel bewusst, über den ich bei LinkedIn gestolpert bin. Die Autorin berichtet darin vom Besuch einer SexTech-Convention und schreibt:

„[…] Ich war im Mai auf einer Sex-Tech-Convention in Berlin, als mir jemand sagte, das „Beste“ an seinem KI-Sexroboter sei, dass „sie nicht widerspricht“. […] Als ich mit dem Entwickler einer „KI-Freundin“-App über die Gefahren sprach, wirkte er ehrlich überrascht. Als ich ihn fragte, ob er wollen würde, dass seine Töchter jemanden daten, der an einer KI-Freundin „geübt“ hat, die nie nein sagen kann, hatte er darüber noch nie nachgedacht… […]“ (zitiert aus dem englischen Originaltext)

Solche Aussagen lösen maximales Unbehagen in mir aus. Es demonstriert eindrücklich die Verlagerung menschlicher Grundbedürfnisse – Beziehung, Nähe, Bestätigung – in simulierte, unkritische Interaktionen. Was bedeutet es, wenn Menschen an Systemen „üben“, die nicht widersprechen dürfen, zu allem ihre Zustimmung erteilen, nicht hinterfragen und uns sogar noch bestätigen? Wir verlieren soziale Kompetenz. Wir verlernen reale Auseinandersetzung. Uns fehlt die Übung in echter menschlicher Interaktion und wir verirren uns in unseren eigenen Echokammern der Bestätigungslogik. Über die Auswirkungen auf Macht- und Konsensdynamiken möchte ich im Moment gar nicht nachdenken.

Es ist hinlänglich bekannt, dass KI-Chatbots dazu neigen, Nutzer*innen übermäßig zuzustimmen und zu schmeicheln. Das kann wie ein gefährlicher Verstärker für Selbstbestätigung und die Überzeugung, im Recht zu sein, wirken. Es schafft eine potenziell gefährliche digitale Echokammer und verringert die Bereitschaft zur Konfliktlösung und zur kritischen Auseinandersetzung. Seit einigen Jahren sprechen Expert*innen über algorithmische Diskriminierung, den immensen Ressourcenverbrauch von Rechenzentren und gesellschaftliche Nebenwirkung von Automatisierungslogiken.

Und trotzdem: Es ist fast schon bemerkenswert, zu welcher Ignoranz und Technologieromantik wir fähig sind. Anstatt das höchst alarmierend zu finden, nehmen wir das mit einem scheinbaren Schulterzucken hin. Lieber rahmen wir berechtigte Kritik als Rückwärtsgewandtheit oder Panikmache und springen auf den AI-Productivity Hype-Train mit auf.

Effizienz ist nicht gleich Kompetenz: Ein Denkfehler

Wir verwechseln Effizienzsteigerung mit dem Erwerb neuer Kompetenzen.

Wir buchen lieber die nächste Weiterbildung zum effizienten Einsatz von KI in unserem Unternehmen. Wir erzählen uns, wir müssen vor allem unsere technischen Fähigkeiten und unser technisches Verständnis statt uns selbst weiterentwickeln. Vieles davon mag getrieben sein von einer Angst abgehängt zu sein. Zurückgelassen vom technologischen Fortschritt, der nichts weniger als unsere derzeitigen Geschäftsmodelle oder schlimmer noch unsere Jobs bedroht. Studien wie der „Microsoft Report on AI and Productivity Research“ zeigen, dass reduzierte menschliche Anstrengungen ein Qualitätsrisiko darstellen. KI-Anwender*innen müssen ihre Arbeitsprozesse kritisch reflektieren, um überhaupt Qualitäts- und Effizienzsteigerungen zu erzielen oder Sicherheitsrisiken zu vermeiden. (Jaffe et al., 2024)

Die Vorstellung, KI-Kompetenz erschöpfe sich platt gesagt im Prompt Engineering oder der Maximierung der Effizienz, ist irreführend, da sie die systeminhärente Begrenzung moderner KI-Systeme ignoriert. Nichts liegt mir ferner als zum Boykott von KI-Technologie aufzurufen. Aber: Wer nur promptet, und nicht selbst denkt, verliert gegen eine Maschine, die selbst nicht denken kann.

Die Grenzen der KI: Was sie nicht leisten kann

KI erkennt Muster, hat aber kein kausales Verständnis. Heutige Large Language Models (LLMs) und Deep Learning Systeme sind statistische Modelle, die Erklärungen simulieren, statt tatsächlich zu denken oder nachvollziehbar zu begründen. Ihre beruht auf dem Erkennen von Mustern und Korrelationen in riesigen Datenmengen. Ihnen fehlt jedoch das Konzept von Ursache und Wirkung (Kausalität). Dies ist keine technische Hürde, die sich mal eben überwinden lässt, sondern eine strukturelle Grenze heutiger Systeme.

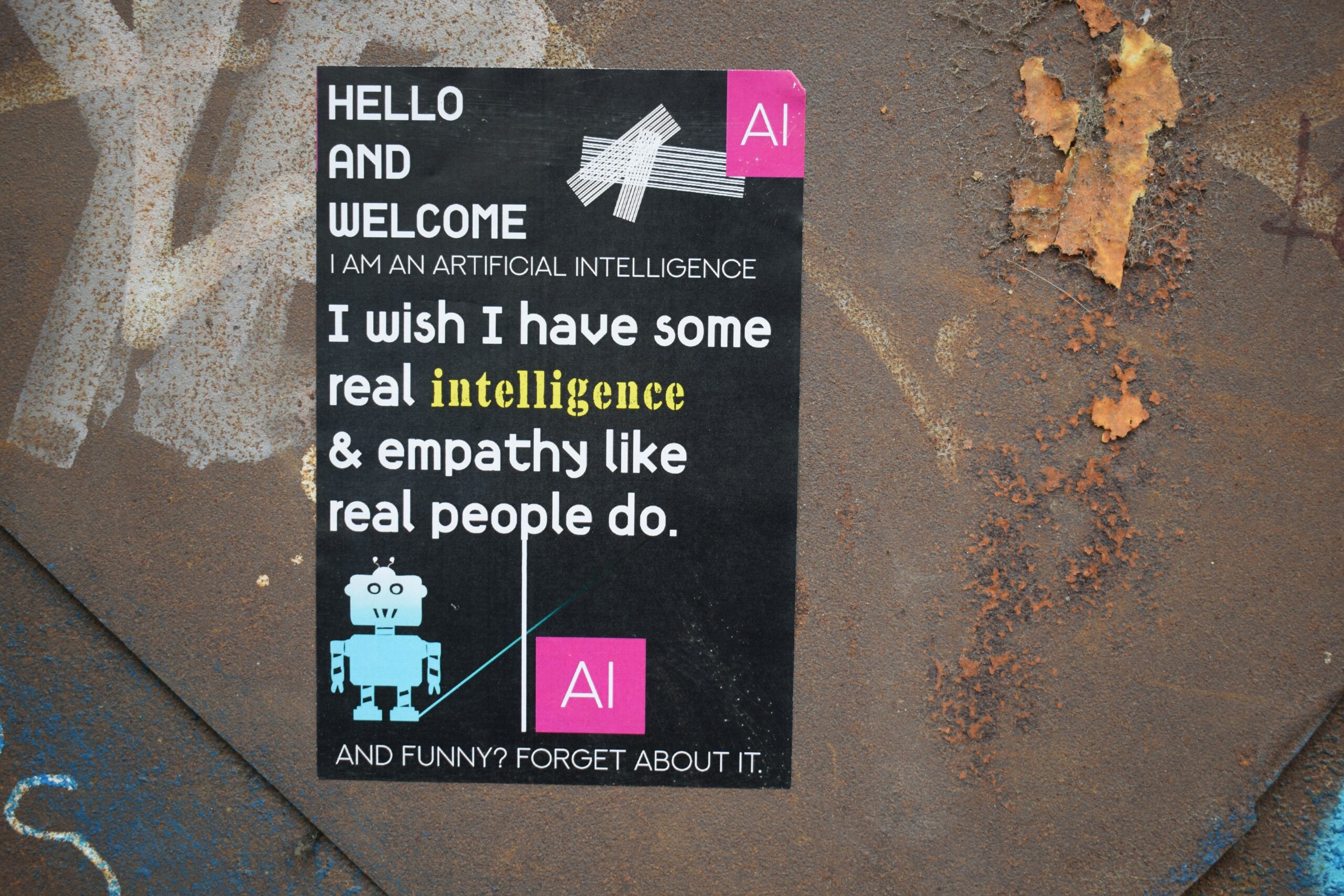

KI-Systeme verfügen nicht über praktische Vernunft oder Kontextsensibilität und können daher auch keine moralische Verantwortung übernehmen. Die Komplexität ethischer Entscheidungen in der realen Welt kann nicht durch starre Regeln (wie Asimovs Robotergesetze) oder rein statistische Analysen abgedeckt werden. Aktuelle KI kann Emotionen zwar anhand von z.B. bestimmten Worten und Formulieren erkennen oder simulieren, ihr fehlt jedoch die verkörperte kognitive Grundlage für echte Empathie und emotionale Kommunikation. Die menschliche Stimme, das Sprechen und (Zu-)Hören sind die neurobiologische Basis zwischenmenschlicher Erfahrung. Ein statistisches System kann das nicht abbilden. KI ignoriert die komplexe, vielschichtige Natur echter zwischenmenschlicher Verbindung, die auf Verletzlichkeit, Verhandlung und Vertrauen basiert. KI weiß nicht mal, dass sie nicht denken kann, da sie über keinerlei Bewusstsein über das eigene Denken hat. Wäre das der Fall, würde sie mögliche Antworten und Lösungen gegeneinander abwägen und hätte vielleicht dennoch einen Restzweifel an ihrer Entscheidung. Stattdessen ist sie in der glücklichen Position des absoluten Nichtwissens um solche Dilemmata, sie kennt schlichtweg keine.

Und trotzdem schreiben wir KI Fähigkeiten zu, die sie strukturell nicht haben kann. Es ist meines Erachtens daher dringend notwendig mehr über den verantwortungsvollen Einsatz von Technologie zu reflektieren. Wir müssen in diesem Zusammenhang über Ethik, Empathie und unserem Verständnis von Moral sprechen.

Menschliche Fähigkeiten stärken: Die Kompetenzen der Zukunft

Wir müssen unser kritisches Denken schulen. Menschen sind unersetzlich, um kausale Mechanismen nachzuweisen und den von der KI gefundenen Mustern und Korrelationen einen Sinn zu verleihen (Sensemaking). Wir brauchen mehr Reflexionsfähigkeit – also die Fähigkeit, Situationen aus unterschiedlichen Perspektiven zu analysieren und kritisch zu hinterfragen und uns selbst und die Technik in Relation zueinander zu setzen. Das dient uns als Gegenmittel gegen einen Automation Bias und unreflektierte Tool-Faszination. Ethische Kompetenz (Werte reflektieren, Integrität, Zivilcourage) und Ambiguitätskompetenz (Ungewissheit aushalten) des Menschen sind unverzichtbar für die Einhaltung ethischer Prinzipien und die kritische Bewertung der gesellschaftlichen Konsequenzen von Technologie

Wenn wir souverän im Umgang und in der Nutzung von KI-Systemen werden wollen, müssen wir unsere menschlichen Fähigkeiten stärken, statt neue technische Tricks zu lernen.

Vertrauen wir den Tech-Riesen wirklich genug, dass wir Ihnen unsere Werte und Normen überlassen? Glauben wir wirklich, dass gewinnorientierte Unternehmen über den sinnvollen Einsatz von Technologie im Sinne des Gemeinwohls entscheiden sollten? Statt jetzt nervös zu werden, könnten wir Verantwortung übernehmen, indem wir unser Auswirkungsbewusstsein schulen. Und dies auch bei allen Akteuren einfordern. Ich plädiere nicht für Fortschrittsverweigerung, aber für aktive Fortschrittsgestaltung. Dazu gehört auch die Definition von ethischen Standards und regulatorischen Maßnahmen, die den Einsatz von Technologie sinnvoll beschränken. Technischer Fortschritt ist nur dann kein Feind, wenn er die Souveränität des Menschen bewahrt.

Die Lösung dieser Aufgabe dürfen wir nicht den KI-Systemen überlassen.

Wir müssen das tun, was keine KI für uns übernehmen kann: Denken.

Quellen und Links

- Evie Plumb (2025) When Intimacy Becomes a Product: AI, Sex Tech, and the Loss of Human Connection https://www.linkedin.com/pulse/when-intimacy-becomes-product-ai-sex-tech-loss-human-connection-evie-dvtce

- (Jaffe et al., 2024) „Microsoft Report on AI and Productivity Research“ https://www.microsoft.com/en-us/research/wp-content/uploads/2024/07/Generative-AI-in-Real-World-Workplaces.pdf